AI Runtime Security: ยกระดับความปลอดภัยองค์กรในยุค AI ไร้พรมแดน

สวัสดีค่ะทุกคน สาลี่ จากคลาสเมธอด เองค่ะ 😃

บทความนี้สาลี่จะมาพูดถึงประเด็นสำคัญเกี่ยวกับความปลอดภัยด้าน AI ที่หลายองค์กรกำลังเผชิญอยู่ในปัจจุบันค่ะ

ซึ่งเนื้อหาที่นำมาอ้างอิง จะเป็นการสรุปเนื้อหาจาก Sessions : AI Runtime Security: Securing Enterprise AI ในงาน AWS Summit Bangkok 2025 ที่ผ่านมานั่นเองค่ะ

AI กับความท้าทายด้านความปลอดภัยที่หลายคนมองข้าม🤖⚠️

โลกของเราก้าวเข้าสู่ยุค AI อย่างเต็มตัวแล้วค่ะ ซึ่งไม่ใช่แค่เทรนด์ชั่วคราวเท่านั้น แต่เป็นการปฏิวัติที่กำลังเปลี่ยนแปลงทุกภาคส่วนอย่างถาวร ปัจจุบันเราเห็น ChatGPT, Gemini หรือ Claude กลายเป็นเครื่องมือประจำวันของมนุษย์เงินเดือนทั่วโลก องค์กรต่างๆ ก็กำลังแข่งขันกันนำ AI มาประยุกต์ใช้เพื่อเพิ่มประสิทธิภาพและความได้เปรียบทางธุรกิจ

แต่สิ่งที่น่าสนใจคือ ในขณะที่เราตื่นเต้นกับความสามารถอันน่าทึ่งของ AI คำถามสำคัญกลับถูกละเลยไปหลายข้อ:

"เรากำลังปกป้องข้อมูลองค์กรจากความเสี่ยงที่มาพร้อมกับ AI หรือไม่?"

"เมื่อทีมงานอัปโหลดเอกสารลับไปยัง ChatGPT เพื่อสรุปข้อมูล—จะแน่ใจได้อย่างไรว่าข้อมูลจะไม่ถูกนำไปเทรนต่อ?"

"องค์กรของคุณมีนโยบายที่ชัดเจนในการใช้ AI หรือยัง หรือปล่อยให้พนักงานต่างคนต่างใช้ตามใจชอบ?"

ความเสี่ยงที่มองไม่เห็นแต่มีอยู่จริง

ความจริงที่น่ากังวลคือ องค์กรส่วนใหญ่กำลังเปิดประตูให้ AI โดยไม่มีการรักษาความปลอดภัยที่เพียงพอ 😱 เปรียบเสมือนการเชิญคนแปลกหน้าเข้าบ้านโดยไม่รู้ว่าเขาจะทำอะไรกับข้อมูลส่วนตัวของคุณ

การใช้ AI แบบไม่มีกลยุทธ์และการป้องกันที่ดีพอ อาจนำมาซึ่งความเสี่ยงหลายประการ:

- การรั่วไหลของข้อมูลสำคัญ

- การละเมิดกฎระเบียบด้านความเป็นส่วนตัว

- ความเสียหายต่อทรัพย์สินทางปัญญา

AI Runtime Security: ทางออกสำหรับองค์กรยุคใหม่ 🚀

ในบทความนี้ สาลี่จะพาทุกท่านไปสำรวจโลกของ AI Runtime Security—มาตรการรักษาความปลอดภัยที่จำเป็นสำหรับองค์กรยุคใหม่ พร้อมแชร์ข้อมูลจากการเข้าร่วม Sessions : AI Runtime Security: Securing Enterprise AI ที่จะช่วยให้ทุกคนสามารถรับมือกับความท้าทายนี้ได้อย่างมั่นใจค่ะ

“เพราะ AI Runtime Security ไม่ใช่แค่เรื่องของทีม IT แต่เป็นเรื่องที่ทุกแผนกในองค์กรต้องให้ความสำคัญ สาลี่เองในฐานะ Sales Representative ของ Classmethod ก็กำลังศึกษาเรื่องนี้อยู่เช่นกันค่ะ ”

ความเสี่ยงจาก AI ที่องค์กรต้องรู้

ปัจจุบัน AI ได้กลายเป็นดาบสองคมที่ทุกองค์กรต้องระวัง แม้จะช่วยเพิ่มประสิทธิภาพการทำงาน แต่ก็มาพร้อมความเสี่ยงที่ไม่ควรมองข้าม:

- AI ทำให้การสร้างมัลแวร์ทำได้รวดเร็วขึ้น และเทคนิคการเจาะระบบก็พัฒนาง่ายขึ้นด้วย

- คีย์พร้อมพ์ที่ไม่ปลอดภัย กลายเป็นช่องทางดึงข้อมูลสำคัญออกจากองค์กร

- ข้อมูลองค์กรอาจรั่วไหล เมื่อพนักงานใช้ AI สาธารณะโดยไม่มีนโยบายควบคุม

🔍 จากการสำรวจล่าสุดพบว่า มากกว่า 57% ขององค์กรทั่วโลกกำลังใช้ Public AI โดยไม่มีการป้องกันที่เพียงพอ นี่คือความท้าทายที่ทุกองค์กรต้องรับมือ

สิ่งที่องค์กรควรระวังในการใช้งาน AI 🕵️♀️

สาลี่ขอแนะนำประเด็นสำคัญที่ทุกองค์กรควรให้ความสนใจ :

1. ความเสี่ยงจากการใช้ AI สาธารณะ

- Prompt Injection

แฮกเกอร์สามารถใช้คำสั่งพิเศษเพื่อหลอก AI ให้เปิดเผยข้อมูลที่ไม่ควรเปิดเผยได้ - ลิงก์อันตราย

AI อาจให้ลิงก์ที่นำไปสู่เว็บไซต์หลอกลวงหรือดาวน์โหลดมัลแวร์ - Sensitive Data Exposure

ข้อมูลสำคัญอาจถูกส่งไปยังบริษัทผู้ให้บริการ AI โดยไม่ตั้งใจ - ข้อมูลรั่วไหลผ่านการเทรนโมเดล

AI อาจนำข้อมูลที่คุณป้อนไปใช้ในการฝึกฝน ทำให้เกิดการรั่วไหลได้

2. การใช้งานไม่เหมาะสม

พนักงานอาจใช้ AI โดย:

- นำข้อมูลลับไปใส่ใน ChatGPT หรือบริการ AI สาธารณะ

- ไม่ทราบว่าองค์กรอนุญาตให้ใช้บริการใดได้บ้าง

- ขาดความรู้เรื่องความเสี่ยงจากการใช้งาน AI

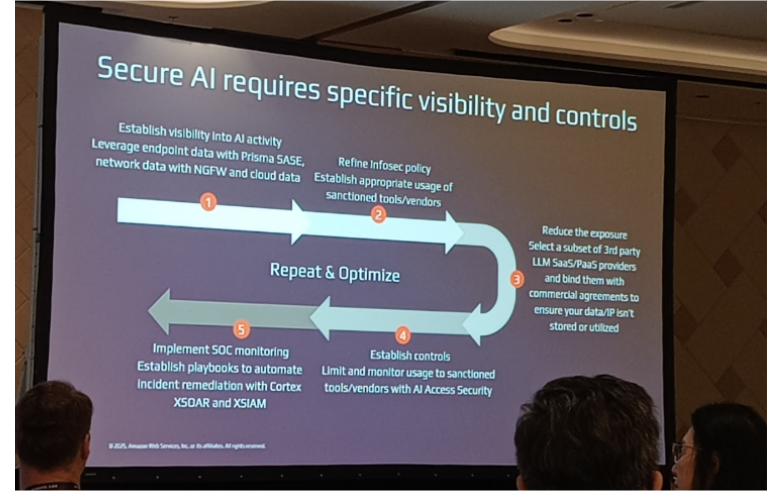

แนวทางการป้องกันและแก้ไข

เพื่อให้การใช้ AI ในองค์กรเกิดประโยชน์สูงสุดและปลอดภัย สาลี่ขอแนะนำวิธีการดังนี้:

1. การตรวจสอบและควบคุม

- ติดตั้งระบบ Monitoring เพื่อติดตามการใช้งาน AI ในองค์กร

- ตรวจสอบการอนุญาต ว่าพนักงานสามารถใช้บริการ AI ใดได้บ้าง

- กำหนดนโยบายชัดเจน เกี่ยวกับการใช้ prompts และการป้อนข้อมูลให้ AI

2. มาตรการเชิงป้องกัน

- ทำข้อตกลง (Agreement) กับผู้ให้บริการ AI เพื่อป้องกันการนำข้อมูลไปใช้ต่อ

- พัฒนา AI ภายในองค์กร สำหรับงานที่ต้องใช้ข้อมูลละเอียดอ่อน

- จัดอบรมพนักงาน เกี่ยวกับการใช้ AI อย่างปลอดภัย

AI Runtime Security: โซลูชันเพื่อความปลอดภัย 🛡️✅

จากการเข้าร่วม Sessions ได้มีการนำเสนอโซลูชัน AI Runtime Security ที่ช่วยให้องค์กรใช้งาน AI ได้อย่างปลอดภัย โดยมีคุณสมบัติดังนี้:

- ตรวจสอบ Prompts แบบเรียลไทม์

สแกนคำสั่งที่ส่งไปยัง AI เพื่อตรวจหาข้อมูลละเอียดอ่อน - API สำหรับการรักษาความปลอดภัย

ช่วยให้นักพัฒนาสามารถรวมการตรวจสอบความปลอดภัยเข้ากับแอพพลิเคชัน AI ได้ - การแจ้งเตือน

หากพบข้อมูลที่อาจเป็นความเสี่ยง ระบบจะแจ้งเตือนทันที

💡 ข้อควรรู้: AI Runtime Security ช่วยปกป้องข้อมูลองค์กรตั้งแต่ขั้นตอนการออกแบบและสามารถทำงานร่วมกับเครื่องมืออื่นๆ ของ AWS ได้อย่างราบรื่น

บทสรุป

การใช้ AI อย่างชาญฉลาดและปลอดภัยไม่ใช่ทางเลือก แต่เป็นความจำเป็นสำหรับธุรกิจในยุคดิจิทัล องค์กรต้อง:

- เข้าใจความเสี่ยงของ AI

- วางนโยบายและมาตรการป้องกันที่เหมาะสม

- ใช้เทคโนโลยีอย่าง AI Runtime Security เพื่อเสริมการรักษาความปลอดภัย

สาลี่หวังว่าบทความนี้จะช่วยให้ทุกท่านเข้าใจและตระหนักถึงความสำคัญของการใช้งาน AI อย่างปลอดภัยในองค์กรมากขึ้นนะคะ 😊

และพบกันใหม่ในโอกาสหน้าค่ะ